Continuons notre série sur la course au volume, en nous attardant aujourd’hui sur la compression. Mais pas que.

Après s’être révélé indispensable chez les diffuseurs radio (et la télé naissante), le compresseur/limiteur va commencer à prendre une part très importante dans la production musicale, à partir de la généralisation de l’enregistrement multipiste (voir Multipiste, une pratique plus ancienne qu’on ne le croit), dans lequel le groupe ne sera plus seulement une entité sonore globale, mais aussi un ensemble d’instrumentistes traités séparément, permettant un plus grand contrôle du volume et de la dynamique de chacun, et des autres traitements, équalisation, spatialisation, etc.

L’enregistrement multipiste n’a rien de négatif en soi, la volonté de la quasi-totalité des ingénieurs du son des années 50 jusqu’au milieu des années 80 ayant été de pouvoir travailler de façon plus précise sur une musique différente, puisque le mélange acoustique, électrique et synthétique (avec l’arrivée des premiers synthés et instruments électriques et électromécaniques) a imposé une autre vision du mixage, tout du moins une façon différente de traiter des éléments, le son d’un groupe, d’un orchestre ne dépendant plus seulement de l’art de l’orchestration et du rapport patiemment élaboré des pupitres entre eux, mais de l’arrivée d’instruments capables, grâce à l’amplification, de surpasser en volume possible tous les autres instruments.

Wah, c’est vachement dynamique !

Combien de fois a-t-on entendu ce contresens à propos d’une musique super compressée, donc souvent très forte (même à niveau faible, on y reviendra), pour décrire ce qui est l’exact inverse de la dynamique ? Ou, in extenso, la plage dynamique, c’est-à-dire la fourchette comprise entre les moments les plus faibles et les moments les plus forts de la musique, du son (on redéfinira tout ça plus tard).

Une bonne gestion de la dynamique, c’est d’abord l’affaire de l’instrumentiste, puisque c’est lui et lui seul qui, au départ, gèrera ses propres nuances : c’est même à la base de toute interprétation. Je prends souvent l’exemple absurde d’un joueur de piano qui jouerait toujours avec la même force, l’ingénieur du son ayant placé 88 micros sur les ensembles de cordes de l’instrument se chargeant ensuite de créer de la dynamique en baissant ou montant les volumes (ce qui ne suffirait pas, bien sûr, mais n’oublions pas que c’est une démonstration par l’absurde…). Or, l’application de surcompression audio (à ne pas confondre avec la compression de données, qui résulte en un allègement du poids des fichiers, et non en une modification de leurs nuances, voir Compression, de quoi ?) revient à nier totalement l’expressivité du musicien, les nuances de la musique, sa respiration, avec des conséquences dramatiques sur la qualité même du son et sur nos oreilles.

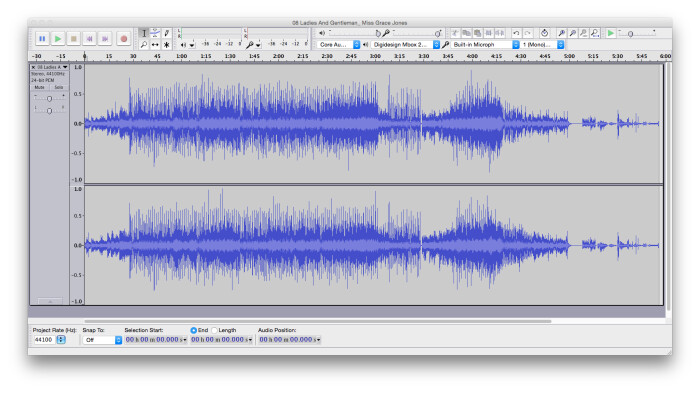

Qu’est-ce qui a bien pu justifier que l’on passe en 30 ans, après des décennies de travail attentionné sur le son, de ça :

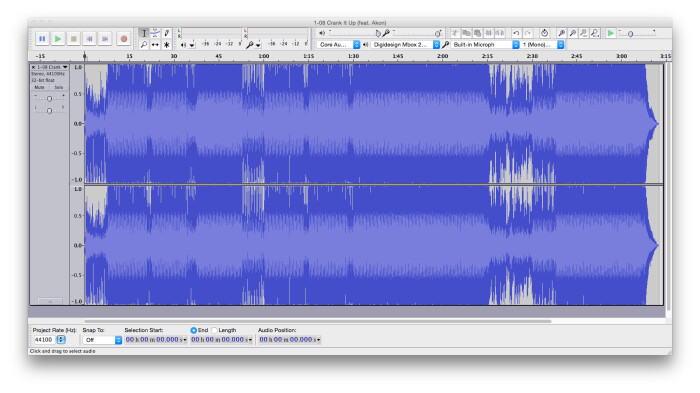

À ça ?

Compression, de quoi ?

Cela semble couler de source, mais l’on rencontre encore souvent des confusions en ce qui concerne la notion de « compression ».

Cela est dû à l’utilisation de la forme abrégée pour parler des deux compressions : l’une est une compression de dynamique (celle effectuée quand on utilise un traitement de la dynamique, famille regroupant compresseurs, limiteurs, expandeurs, transient shapers, etc.), l’autre une compression de données (celle mise en œuvre lorsque l’on cherche à réduire le poids d’un fichier, quel qu’il soit, afin de faciliter sa transmission, notamment par internet).

La première permet, entre autres, de réduire les écarts entre moments faibles et moments forts d’un fichier audio, résultant en une possible augmentation du volume global. La seconde, conçue à l’origine pour remédier aux faibles débits des premiers protocoles de communication via internet, permet de réduire de façon parfois très significative le poids d’un fichier, et donc le débit nécessaire pour le transférer d’un point à un autre (ou le lire en streaming).

Pour l’audio comme pour d’autres médias, le débit par seconde se mesure en kbit/s (ou kb/s, sauf flux multicanal en très haute résolution) ; par exemple, pour un fichier stéréo en 16 bits/44,1 kHz (Wav ou AIFF), le débit est à peu près de 1412 kb/s (et de 2117 kb/s pour sa version en 24 bits). Quand on parle de MP3 128, d’AAC 256, le nombre indique son débit, soit 128 kb/s et 256 kb/s. Quand on les compare à ceux de l’audio non compressé (compression de données !), on comprend que de nombreuses choses ont été perdues entre les deux états du fichier audio. Avec quelle incidence sur la qualité intrinsèque de l’audio ? On y reviendra…

Multipiste, une pratique plus ancienne qu’on ne le croit

D’aucuns datent l’enregistrement multipiste des essais effectués par Les Paul dans les années 50 avec son enregistreur maison Ampex ou aux albums des Beatles réalisés avec des quatre-pistes (lire l’excellent En studio avec les Beatles de Geoff Emerick et Howard Massey, chez Le Mot Et Le Reste). Or, dès l’abandon des moyens acoustiques et mécaniques, et avec l’arrivée des procédés électriques, des enregistrements ont utilisé l’overdubbing (superposition de prises de son) dès la fin des années 20, notamment chez RCA Victor. L’historique maison de disques et d’édition a ainsi procédé à l’ajout de parties orchestrales sur des enregistrements piano-voix de Caruso, célèbre chanteur lyrique de l’époque, après la mort de l’artiste.

Et du côté de l’industrie cinématographique, un de ses rares véritables génies, Rouben Mamoulian, pratiquera dès 1929 « l’enregistrement sur deux canaux et les overdubs dans Applause. » 1

D’ailleurs, saviez-vous que la vitesse de rotation des vinyles longue durée, c’est-à-dire 33 tours 1/3 par minute, vient de cette même industrie, lorsque les tentatives de synchronisation image-son hésitaient entre un procédé mécanique (Vitaphone, association projecteur-phonographe) et un autre, optique (Movietone, fixation optique du son sur pellicule développée par Theodore Case et la Fox) ? Pour les tenants du Vitaphone (la Warner), les durées des « disques » disponibles à l’époque n’étaient pas suffisantes pour tenir la durée d’une bobine de film (10 mn). Le choix était possible entre agrandir la surface du disque (ajoutant à sa déjà grande fragilité) ou ralentir sa vitesse de rotation. La seconde option fut donc choisie… Enter le 33 tours !

1 – Kathryn Kalinak, Film Music, A Very Short Introduction, Oxford UP, 2010.